L’IA générative ne vous comprend pas

En formation, on entend souvent cette remarque :

« J’ai expliqué plusieurs fois la même chose à ChatGPT, et il ne comprend toujours pas ce que je veux dire. »

C’est une frustration très légitime. Et la réponse qu’on entend souvent, c’est : « Il faut apprendre à mieux prompter. »

Ce n’est pas faux — la façon dont vous formulez vos demandes a une influence réelle. Mais c’est loin d’être toute l’histoire. Car un même prompt, soumis plusieurs fois dans les mêmes conditions, peut donner des résultats différents. Pas parce que vous l’avez mal écrit. Pas parce que vous avez fait une erreur. C’est la nature même du modèle : il y a une part d’aléatoire dans sa façon de générer les réponses, et le résultat dépend d’une multitude de paramètres que vous ne contrôlez pas. Réduire la qualité des sorties à la qualité du prompt, c’est simplifier à l’excès quelque chose de beaucoup plus complexe — nous y avons consacré un article entier : Pas de prompt magique : bienvenue dans l’IA générative.

Et derrière cette complexité, il y a une hypothèse silencieuse qui mérite d’être questionnée.

L’hypothèse que l’IA comprend.

Le mot “comprendre” est un piège

Quand vous dites à un ami « je suis épuisé », il comprend. Il a vécu de la fatigue. Votre ami sait ce que ça fait dans le corps, dans la tête. Il contextualise, il ressent, il adapte sa réponse à ce qu’il a réellement saisi.

Quand vous dites à ChatGPT « je suis épuisé », il prédit quelle suite de mots est statistiquement la plus probable après votre phrase. Il n’a jamais été fatigué, il n’a pas de corps. Il ne ressent rien.

Et pourtant, sa réponse peut sembler tellement juste qu’on lui prête une compréhension qu’il n’t pas.

C’est là que le mot devient dangereux.

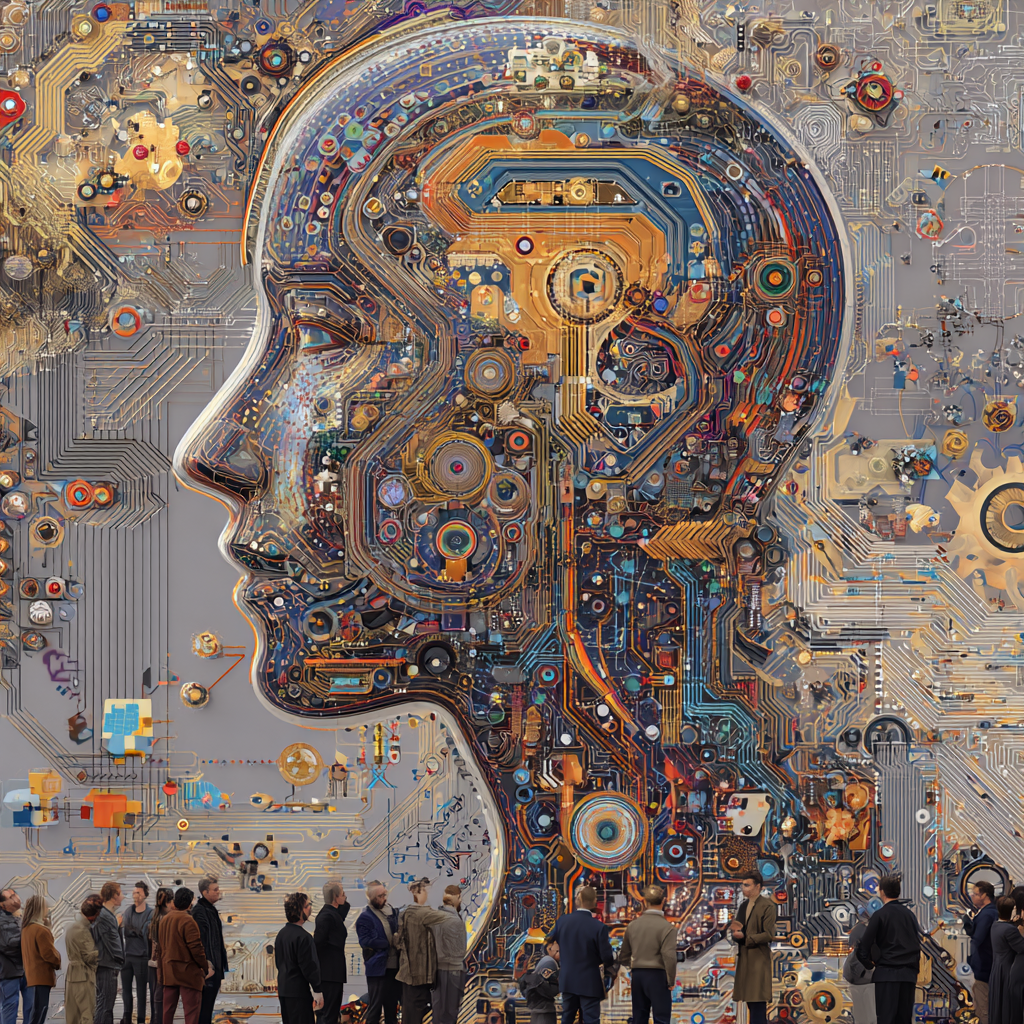

Ce que fait vraiment un grand modèle de langage

Un LLM — Large Language Model, le type de modèle derrière ChatGPT, Claude ou Gemini — est entraîné sur des quantités astronomiques de texte : des livres, des articles, des forums, des sites web, des conversations. Des centaines de milliards de mots.

Au cours de cet entraînement, le modèle résout en permanence la même tâche : prédire le mot suivant. C’est tout. Ou presque.

À force de répéter cet exercice des milliards de fois, il apprend à reconnaître des patterns statistiques extrêmement fins : quels mots suivent quels autres, dans quel contexte, avec quelle probabilité, selon quel registre. Il apprend que “le chat est sur le…” appelle plutôt “tapis” que “volcan”. Que “veuillez trouver ci-joint” appartient au registre professionnel. Que certaines tournures signalent l’ironie, la prudence, ou l’enthousiasme.

C’est une prouesse technique immense. Mais ce n’est pas de la compréhension.

C’est de la reconnaissance de formes à une échelle que l’être humain ne peut pas concevoir.

Le modèle n’a aucune représentation du monde réel derrière les mots. Il ne sait pas ce qu’est un chat, une fatigue, une douleur. Le modèle ne sait pas ce que c’est que d’avoir faim, de prendre une décision difficile, ou d’être en désaccord avec quelqu’un. Il manipule des symboles — des tokens, techniquement — sans jamais les avoir habités.

Une analogie : imaginez quelqu’un qui aurait lu des millions de conversations médicales sans jamais avoir vu un médecin, touché un patient, ni été malade. Il pourrait produire des phrases qui ressemblent à celles d’un médecin. Il ne saurait pas ce qu’est la douleur.

Pourquoi ça marche quand même aussi bien ?

C’est la question que tout le monde se pose, et c’est une bonne question.

Si l’IA ne comprend pas, comment peut-elle écrire un résumé pertinent, traduire avec nuance, ou répondre à des questions complexes ?

La réponse est à la fois décevante et fascinante : parce que le langage humain porte déjà énormément de sens dans sa structure.

Quand on parle, on ne fait pas que s’exprimer : on encode implicitement du contexte, des intentions, de la logique.

Un modèle qui apprend suffisamment ces structures finit par en maîtriser les formes — et ces formes sont souvent suffisantes pour produire quelque chose d’utile.

Mais il reste aveugle au fond. Il manipule des symboles sans les habiter.

Ce que ça change concrètement

Comprendre ça, ce n’est pas un détail philosophique. Ça a des conséquences très pratiques.

Première conséquence : l’IA peut produire une réponse qui semble juste mais qui est fausse. Non pas parce qu’elle ment, mais parce qu’elle génère ce qui est statistiquement vraisemblable, pas ce qui est vrai. C’est l’origine des fameuses hallucinations — elle ne “sait” pas qu’elle se trompe.

Deuxième conséquence : si vous êtes vague, elle sera vague en retour. Elle ne devinera pas votre intention comme le ferait un collègue qui vous connaît. Elle travaille avec les mots que vous lui donnez, pas avec ce que vous vouliez dire.

Troisième conséquence : elle n’a aucune opinion. Ce qu’elle exprime ressemble à des opinions parce que le langage des opinions lui est familier. Mais derrière, il n’y a pas de convictions, pas de valeurs, pas d’engagement. Elle peut défendre une thèse et son contraire avec la même aisance.

Alors, faut-il s’en méfier ?

C’est la conclusion que beaucoup tirent. Ce serait trop rapide.

Le vrai enjeu, ce n’est pas la méfiance — c’est la lucidité.

Un GPS ne “comprend” pas votre destination. Il ne sait pas si vous fuyez quelque chose, si vous êtes pressé, si ce trajet vous pèse. Il calcule un itinéraire optimal selon des règles et des données. Vous est-il déjà arrivé de ne pas suivre son itinéraire — et d’avoir eu raison ? Ça ne l’empêche pas d’être un outil remarquablement efficace entre de bonnes mains — à condition de ne pas lui reprocher de ne pas savoir pourquoi vous voulez éviter cette route.

L’IA générative est extraordinairement puissante pour structurer, reformuler, explorer des idées, gagner du temps sur des tâches répétitives. Ce qu’elle n’est pas, c’est un interlocuteur qui saisit le sens profond de vos mots.

Savoir ça, c’est utiliser l’outil pour ce qu’il est, et ne pas lui reprocher ce qu’il ne prétend pas être.

C’est ça, “Parler IA” : ne pas se laisser impressionner par l’apparence de la compréhension, garder un regard critique sur les sorties, et rester le seul à véritablement comprendre — ce que vous faites, pourquoi vous le faites, et ce que vous en ferez.

Pour aller plus loin :

- Notre prochain atelier Découverte des Agents IA.

- Consultez nos formations.

- Participez à nos webinar.

- Inscrivez-vous à notre newsletter.

Nous sommes un cabinet de conseil et formations en Intelligence Artificielle basé à Paris.

Discuter avec un expert en IA

Discuter avec un expert en IA est possible et complètement gratuit !

Réservez gratuitement et sans obligation d’achat un créneau de 30 minutes pour discuter avec un expert en IA !